I ljuset av Trump-förbudet, extremhögerns hatretorik och de rent konstiga QAnon-konspirationsteorierna, fokuseras världens uppmärksamhet alltmer på moderering av och av sociala medieplattformar.

Vårt arbete på AKASHA bygger på tron att människor inte är problem som väntar på att bli lösta, utan potentiella som väntar på att utvecklas. Vi är dedikerade till att utvecklas, och så då till att möjliggöra, vårda, utforska, lära, diskutera, självorganisera, skapa och återskapa. Och det här inlägget utforskar vårt tänkande och vad vi gör när det gäller moderering.

Modererande processer är fascinerande och väsentliga. De måste uppmuntra och tillgodose komplexiteten i gemenskapen, och deras design kan bidra till fenomenal framgång eller dyster misslyckande. Och oavsett, vi kommer aldrig att gå direkt från noll till hjälte här. Vi måste arbeta upp det här tillsammans.

Vi ska börja med att definiera några vanliga termer och skingra några vanliga myter. Sedan utforskar vi några viktiga designöverväganden och skisserar de inblandade feedbackmekanismerna, innan vi presenterar de modererande målen som vi ser dem just nu. Alla kommentarer och feedback är välkomna.

Vi kommer att betona en sak om vår Ethereum World-resa — det är ingen som helst mening för AKASHA-teamet att diktera vägreglerna, som vi hoppas kommer att bli allt tydligare under de kommande veckorna och månaderna.

Låt oss göra det här.

"Början av visdom är definitionen av termer." En riktig sanning som tillskrivs Sokrates.

Styrande — bestämmande auktoritet, beslutsfattande och ansvarsskyldighet i processen att organisera [ref].

Modererar — den delmängd av styrning som strukturerar deltagande i en gemenskap för att underlätta samarbete och förhindra missbruk [ref].

Censurering — förbjuda eller undertrycka information som anses vara politiskt oacceptabel, obscen eller ett hot mot säkerheten [Oxford English dictionary].

En persons moderering är en annan persons censur, vilket denna diskussion bland Reddit-redaktörer vittnar om. Och även om det har visat sig att den centraliserade moderering som genomförs av sådana som Facebook, Twitter och YouTube utgör "ett detaljerat system som är förankrat i det amerikanska rättssystemet med regelbundet reviderade regler, utbildat mänskligt beslutsfattande och beroende av ett system för yttre påverkan ”, är det tydligt ”de har lite direkt ansvar gentemot sina användare” [ref].

Den sista biten passar oss inte bra, och om du läser det här är det mycket troligt att det inte flyter din båt heller. Vi har inte behövt förlita oss på att privata företag tar denna roll genom historien, och vi har inte för avsikt att förlita oss på dem i framtiden.

Subjektivt kan moderering kännas som censur. Det kan vara när moderatorn verkligen har gått "för långt", eller när personen inte känner sig tillräckligt befogad att försvara sig, men också när ämnet verkligen bara är ett skitstövel.

Som ni kommer att föreställa er, är AKASHA inte procensur. Snarare inser vi att konsekvensen av yttrandefrihet är uppmärksamhetsfrihet. Bara för att jag skriver något betyder det inte att du måste läsa det. Bara för att jag fortsätter skriva saker betyder det inte att du måste fortsätta att se att jag fortsätter skriva saker. Detta är en riktigt viktig observation.

AKASHA drivs av att bidra till att skapa förutsättningar för framväxten av kollektiva sinnen, dvs intelligenser större än summan av deras delar. Alla som dras till AKASHA, och faktiskt till Ethereum, är intresserade av att hjälpa till att uppnå något som är större än de själva, och vi har inte hittat en online "gratis för alla" som leder till ett sådant resultat.

Storskaliga sociala nätverk utan lämpliga modererande åtgärder är utformade för att ta emot extremister, eller locka till sig extremister eftersom värden har gett upp att försöka designa för moderering. En gemenskap utan modererande processer saknar väsentlig struktur, vilket lämnar det lite mer än en degenerativ röra som många skulle undvika.

Många sociala nätverk och diskussionsfora inkluderar en roll som ofta kallas moderator , men varje medlem i varje community har vissa modereringsmöjligheter. Detta kan vara explicit — t.ex. flagga innehåll för granskning av en moderator – eller implicit – t.ex. på väg mot ett eldkrig med lugnande ord.

Om en gruppmedlem är aktiv modererar hon. Med andra ord, hon hjälper till att upprätthålla och utveckla de sociala normer som styr deltagande. Som en allmän tumregel gäller att ju mer vi kan ge deltagarna möjlighet att erbjuda lämplig positiv och negativ feedback, desto mer lämpligt kan vi se en samlad konsekvens, desto fler axlar tar upp den väsentliga modereringsinsatsen. Vi får veta när vi har kommit dit när rollen vi kallar moderator verkar irrelevant.

Modererande åtgärder kan vara tillräckligt enkelt, men övergripande modererande design är lika mycket konst som vetenskap. Det är uppifrån och ner, nerifrån och upp och från sida till sida, och komplext …

Komplexitet avser de fenomen där ett system kan uppvisa egenskaper som inte kan spåras till en eller två individuella deltagare. Komplexa system innehåller en samling av många interagerande objekt. De involverar effekten av feedback på beteenden, systemets öppenhet och den komplicerade blandningen av ordning och kaos [ref]. Många interagerande människor utgör ett komplext system, så det går inte att komma runt detta i Ethereum World-sammanhang.

Lagen om erforderlig variation hävdar att ett systems kontrollmekanism (d.v.s. den styrande, speciellt den modererande i sammanhanget här) måste kunna uppvisa fler tillstånd än själva systemet [ref]. Underlåtenhet att konstruera för detta gör att systemet kan misslyckas. Här är några exempel på fellägen i detta avseende:

Låt oss ta en titt på några av de saker vi måste ta hänsyn till, olika återkopplingsslingor och våra modererande mål.

Det finns ett antal designöverväganden på toppnivå [ref]. Dessa inkluderar:

Mänsklig interaktion involverar subtilitet, sammanhang, ironi, sarkasm och multimedia; faktiskt många kvaliteter och format som inte är lätta att algoritmisk tolkning. Helautomatisk moderering är inte genomförbar idag (och vi kanske hoppas att det förblir så länge), så det lämnar oss med helt manuella modereringsprocesser och datorstödda modereringsprocesser.

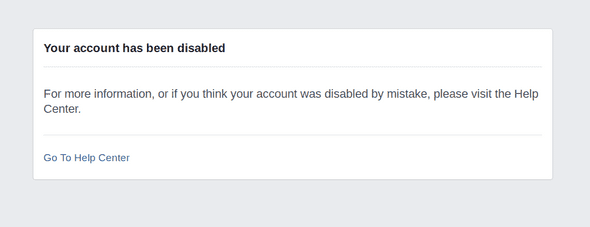

"Ditt konto har inaktiverats."

Det här är allt du får när Facebooks automatiska moderering sätter igång. Ingen förklaring. Ingen transparens. På AKASHA använder vi som standard transparens, obvs.

Först när folk känner till en lag kan den vara effektiv. Först när människor lär sig om en social norm kan den bestå. Både lagen och sociala normer avskräcker men förhindrar inte subversion. Straff är tillgängligt när det avskräckande medlet är otillräckligt – i själva verket validerar det avskräckningen – och båda behövs i modererande processer.

Decentralisering är ett medel snarare än ett självändamål [ref]. I det här fallet bidrar decentraliserade modereringsprocesser till en känsla av gemenskaps "äganderätt", personlig byråkrati och helst mer organisk skalning.

Vissa modereringsprocesser utspelar sig i vardagliga interaktioner medan andra kräver dedikering av tid till uppgiften. Den tidsfördelningen är antingen externt motiverad (t.ex. för betalning, enligt Facebooks moderatorer), eller inneboende motiverad (t.ex. för sakens skull, enligt Wikipedia-gemenskapen). Det sägs ofta att de två inte blir bekväma sängkamrater, men samtidigt finns det många människor där ute som dras till att arbeta för "en god sak" och tjäna sitt levebröd på det.

Vi dras till att stödja och förstärka inneboende motivationer utan att ställa tunga krav på tid för en handfull samhällsmedlemmar. Modererande processer ska kännas lika normalt som att inte tappa skräp och då och då plocka upp någon annans kasserade colaburk. När de börjar känna sig mer som ett frivilligt valplock, ställs frågor om att "göra din berättigade andel" i samband med en potentiell tragedi för allmänningen.

Ingenting med moderering är någonsin statiskt. Vi kan överväga fem nivåer av feedback:

Att demonstrera och observera beteenden på en daglig basis är en primär källa och upprätthållare av en gemenskaps kultur – hur vi gör och inte gör saker här. Vi kan kalla det moderering genom exempel.

Detta handlar mer uttryckligen om att påverka cirkulationen av innehåll och den form de flesta tänker på när de överväger måttfullhet. En typisk form av feedback från den andra slingan exemplifieras av innehållet som har samlat på sig tillräckligt med flaggor för att motivera uppmärksamhet av en moderator – någon med auktoritet att utöva ett bredare utbud av modereringsprocesser och/eller större befogenheter när det gäller att utöva dem. Även om det ibland verkar spela andra fiol till korrigerande feedback, innehåller 2nd loop också positiv feedback som hyllar bidrag och handlingar som samhället skulle älska att se mer av.

Samhällets deltagande struktureras av modererande processer. Tredje-loop feedback kan sedan fungera för att granska och trimma eller anpassa eller utöka dessa strukturer, granska medlemmars byrå, genom regelbundna utnämningar eller genom undantag.

Moderering är en form av styrning - processerna för att bestämma auktoritet, beslutsfattande och ansvarsskyldighet. Fjärde-loop-feedback kan sedan fungera så att resultaten av 1:a-, 2:a- och 3:e-loopfeedback föranleder en översyn av samhällsstyrningen eller bidrar till periodiska granskningar.

När infrastrukturen ägs och/eller drivs av en juridisk person, har den enheten juridiskt ansvar under relevanta jurisdiktioner som kan kräva att visst innehåll tas bort. När innehållsadresserbar lagring används (t.ex. IPFS, Swarm) är det svårt att ta bort men avlistning är fortfarande ganska genomförbart när upptäckten kräver underhåll av ett sökindex.

Vi har identifierat åtta modererande designmål. Det kommer alltid att vara användbart i våra framtida diskussioner tillsammans för att identifiera om någon meningsskiljaktighet har att göra med ett måls giltighet eller sättet att uppnå det.

Vi firar yttrandefrihet och uppmärksamhetsfrihet, likaså.

Modereringsåtgärder måste vara tillgängliga för alla. Period.

Modererande åtgärder av olika medlemmar kan få olika vikt i olika sammanhang enbart för att motverka manipulation/spelande och hjälpa till att upprätthålla nätverkshälsan. Enkelt uttryckt kan "gamla händer" vara mer flytande i modererande åtgärder än nybörjare, och vi vill också förstärka människor och minska skändliga bots i detta avseende.

Modereringsprocesser bör vara enkla, icke-universella (förutom åtgärder som krävs för att följa lagar) och distribueras.

De involverade medlemmarna och modereringsprocesserna bör skapa erforderlig komplexitet.

Vi vill uppmuntra produktiv utjämning och arbeta mot giftig utjämning, för nätverkshälsa i jakten på kollektiv intelligens.

Modererande processer bör hjälpa till att förmedla att med rättigheter (t.ex. frihet från daghem i centraliserade sociala nätverk) följer ansvar.

Moderering av processer bör vara enkla för arkitekten i webb 2 initialt, och inte uppenbarligen omöjliga i webb 3-stacken på längre sikt. Om vi får det rätt, bör en visualisering av lämplig nätverksanalys producera något liknande bilden i mitten här:

Denna lista är inte på något sätt uttömmande eller slutgiltig. Samtalet om moderering fortsätter, men det behöver dig! Om du tror att du skulle vilja vara en större del av detta i tidiga skeden, vänligen kontakta oss. Om du känner att det saknas något uppmuntrar vi dig också att gå med i konversationen här och här.

Utvalda bildtexter:Courtney Williams på Unsplash

Nästa GameStop? 25 aktier med hög kort ränta

Enterprise Ethereum Alliance avancerar Web 3.0-eran med offentlig utgivning av Enterprise Ethereum Architecture Stack

Ska jag börja ge bort pengar (eller till och med mitt hus) till mina barn?

Kan jag få bättre avkastning från aktier istället för aktiefonder?

Hur man löser in en check i mataffären